本日はMetaQuestの学習枠です。

MetaHorizonの開発ドキュメントを読みながら実際に開発を行ってみました。

前回記事

本記事は以下の前回記事の続きです。

bluebirdofoz.hatenablog.com

MetaHorizonの開発ドキュメント

MetaHorizonの開発ドキュメントを実際に手を動かしながら実行時のキャプチャをしていきます。

developers.meta.com

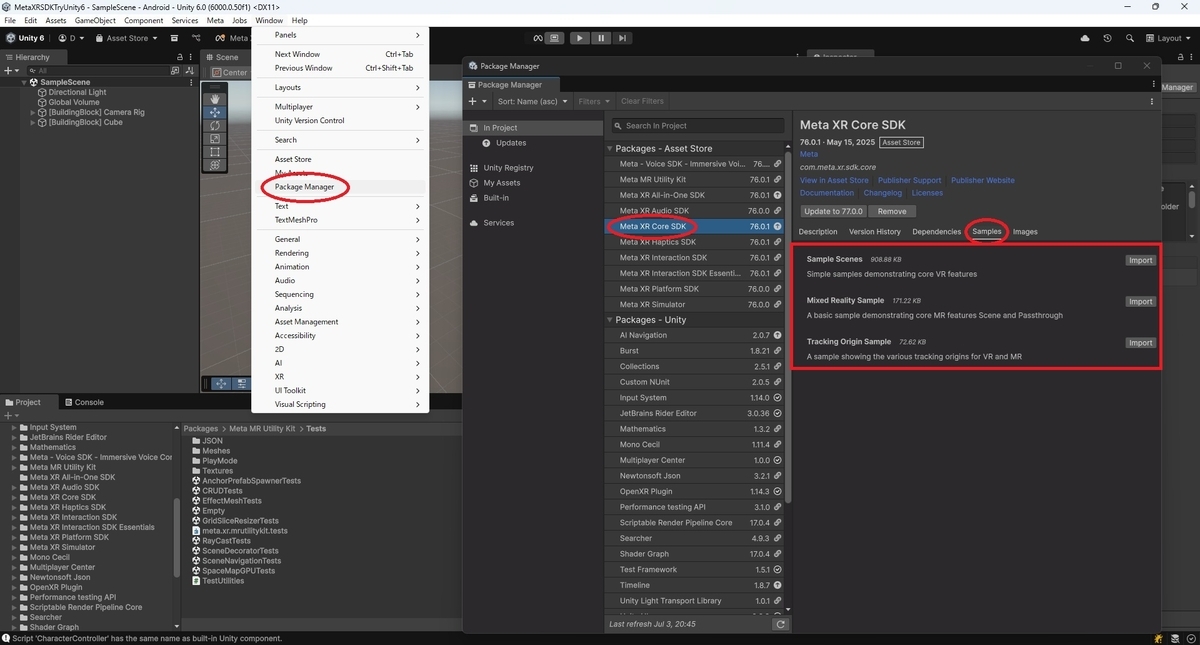

本記事は以下の「Meta XR Core SDKサンプル」の記事を試します。

developers.meta.com

Meta XR Core SDKサンプル

Meta XR Core SDK UPMパッケージには、SDKの使用を開始するためのサンプルプロジェクトが3つ含まれています。

複合現実サンプル(Mixed Reality Sample)

Core SDKを使った複合現実機能の実装方法を示す2つのシーンを含むプロジェクトです。

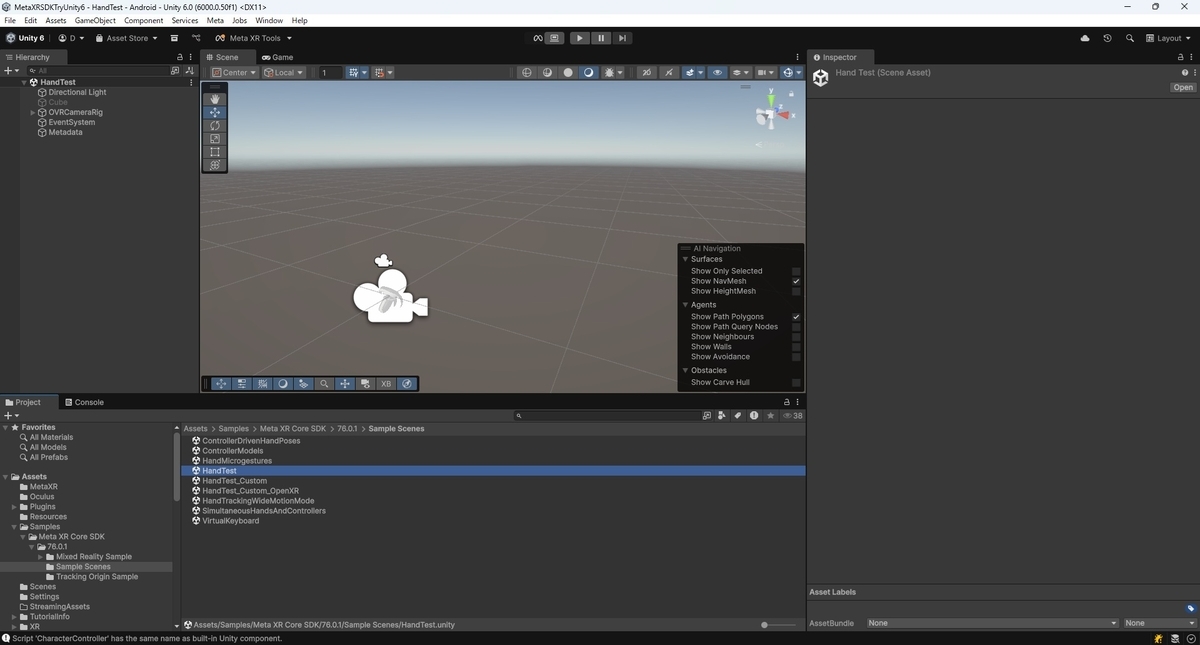

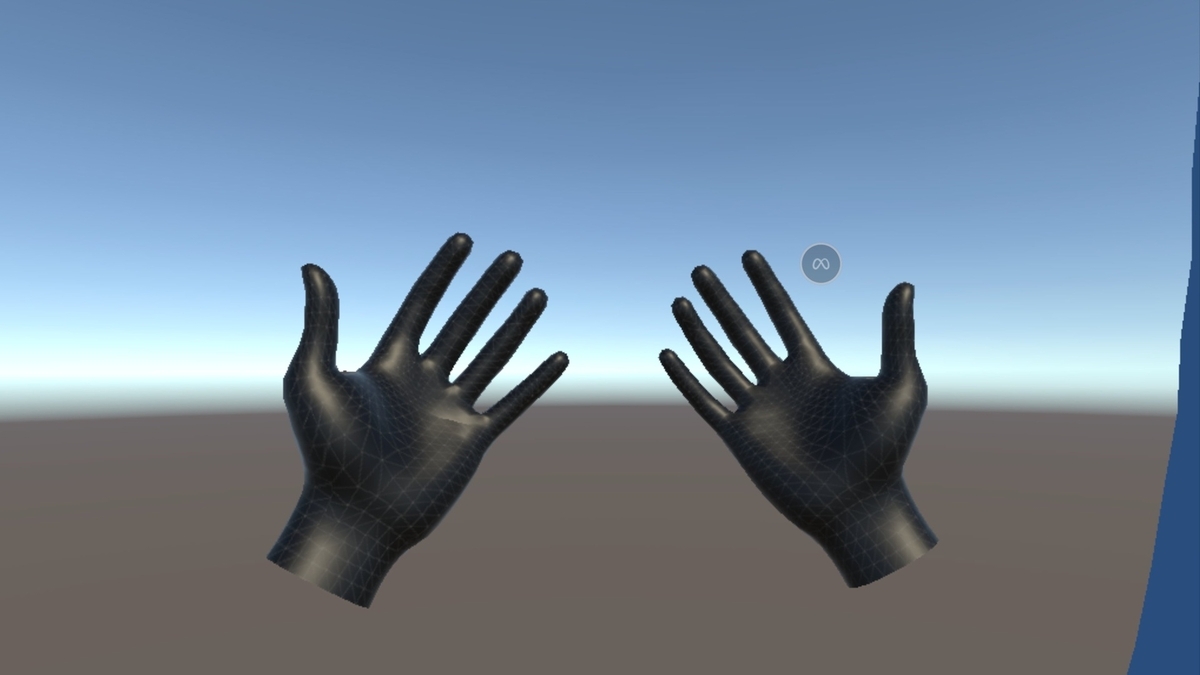

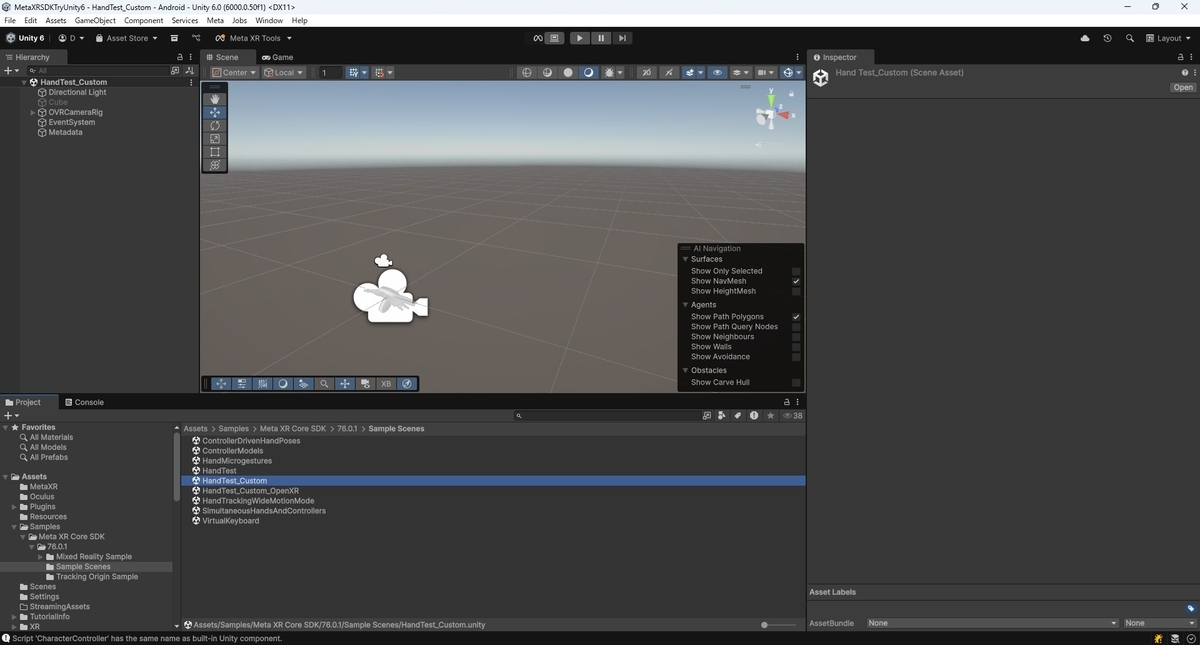

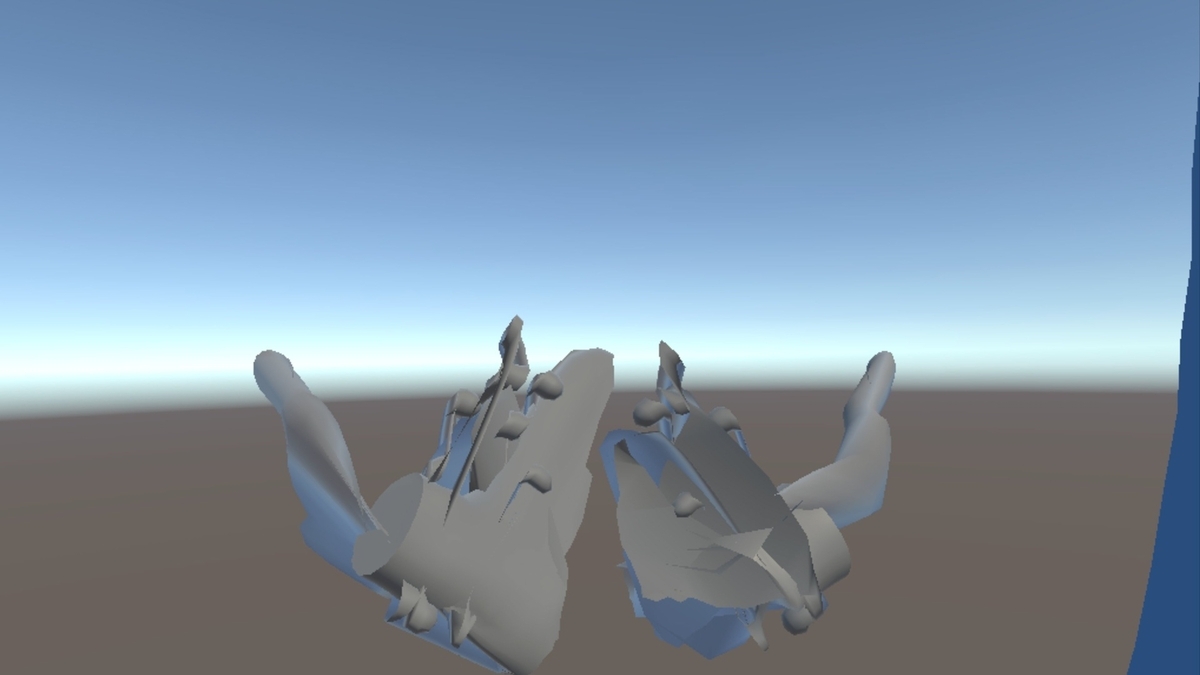

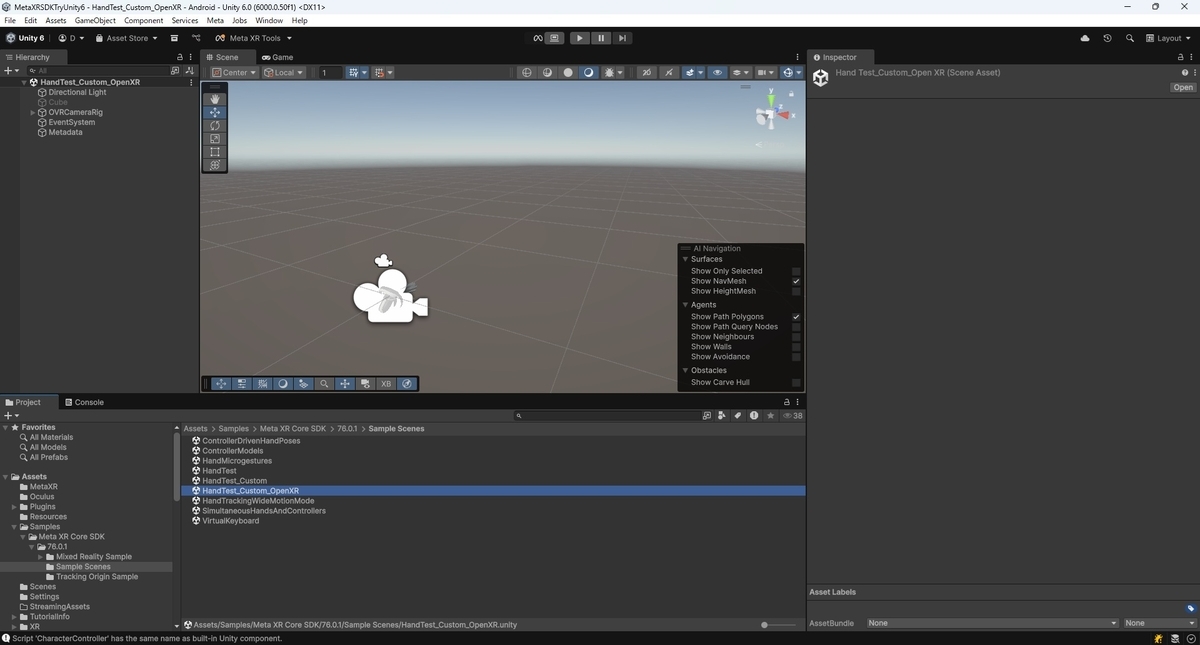

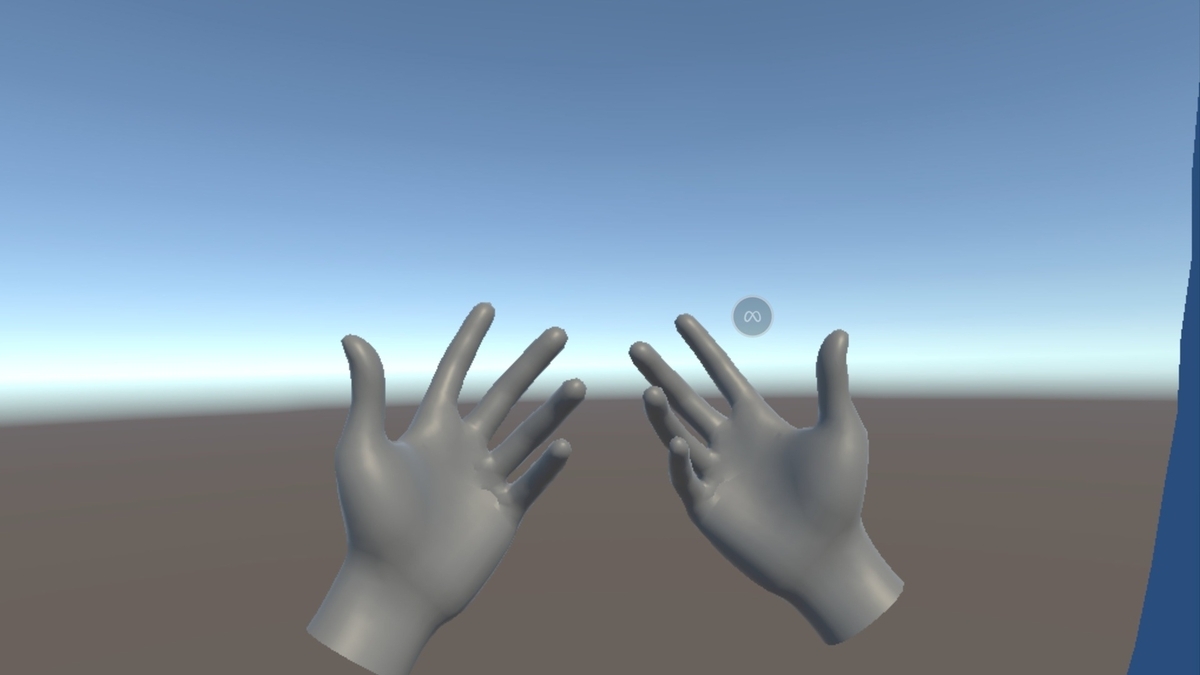

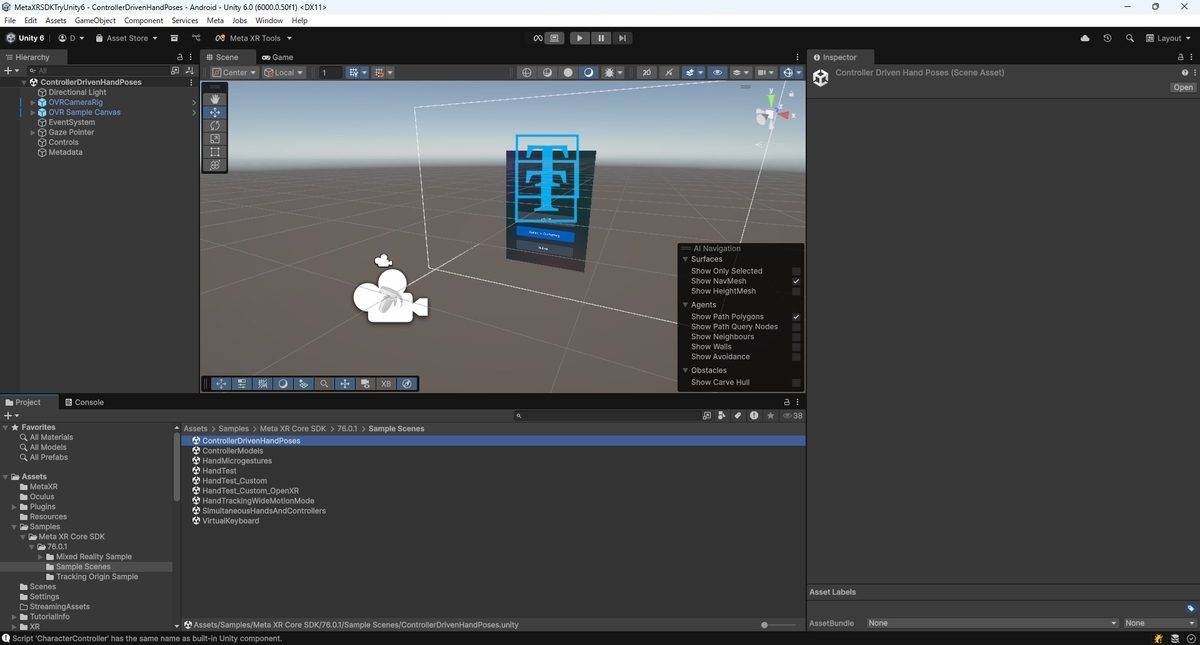

サンプルシーン(Sample Scenes)

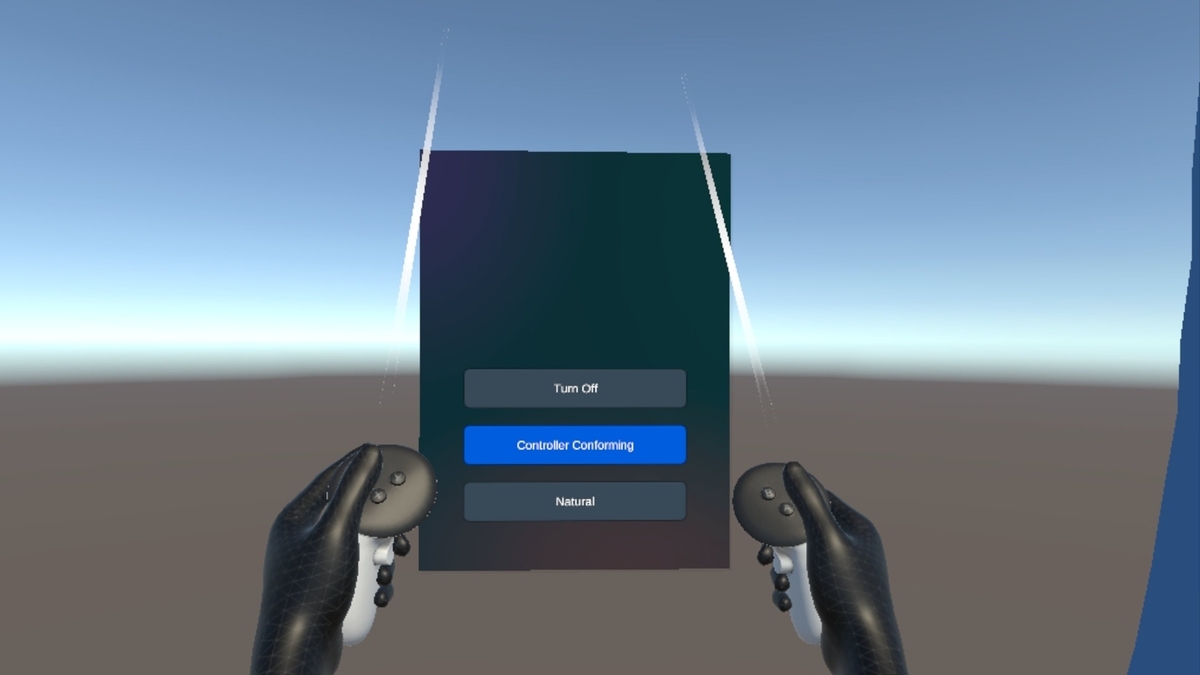

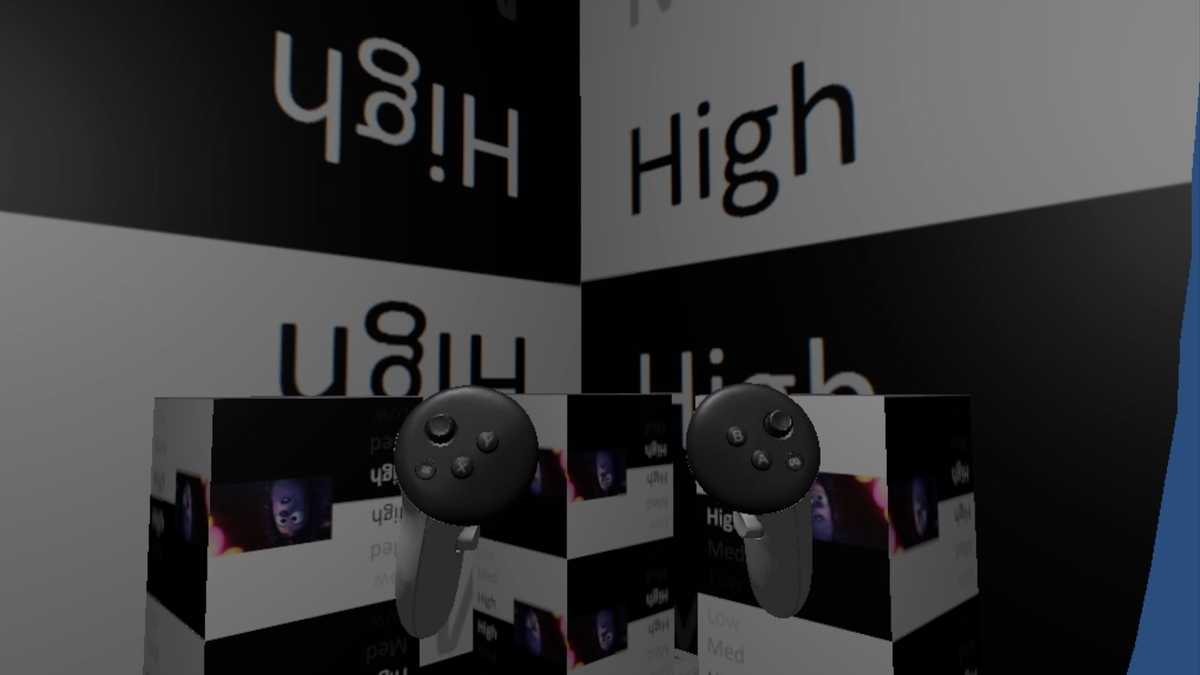

ControllerDrivenHandPoses

このサンプルはコントローラーを使うときに論理的な手のポーズを提供するためにCapsenseを使う方法を示しています。

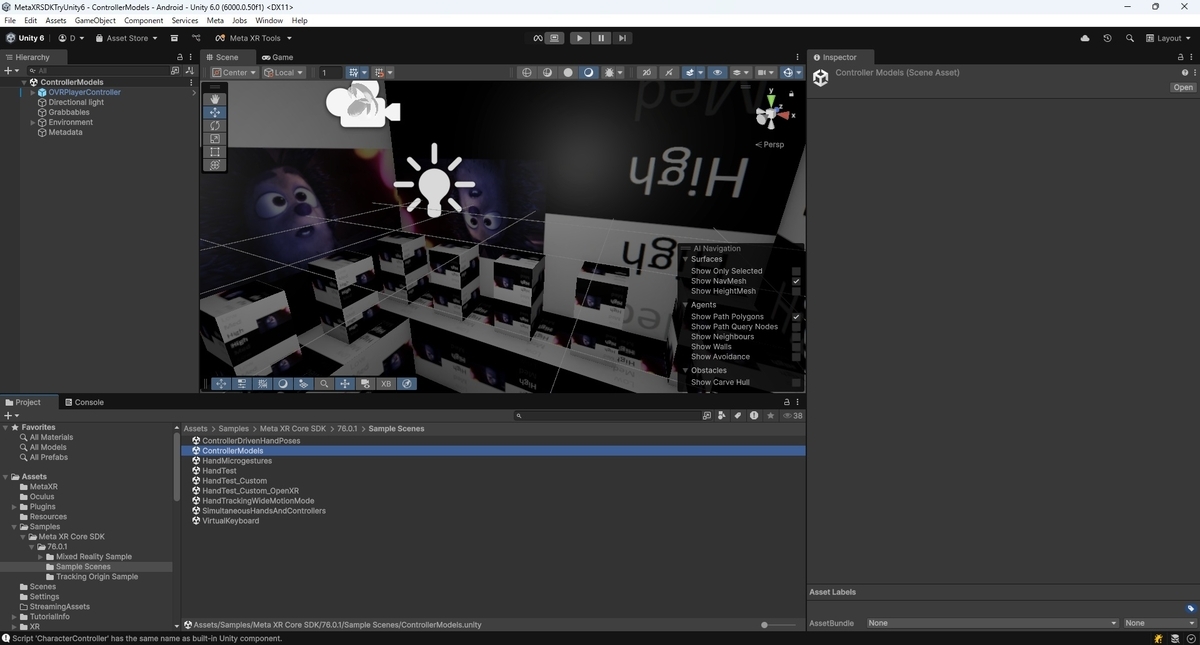

ControllerModels

このサンプルはCore SDKとコントローラーモデルを統合することを示しています。

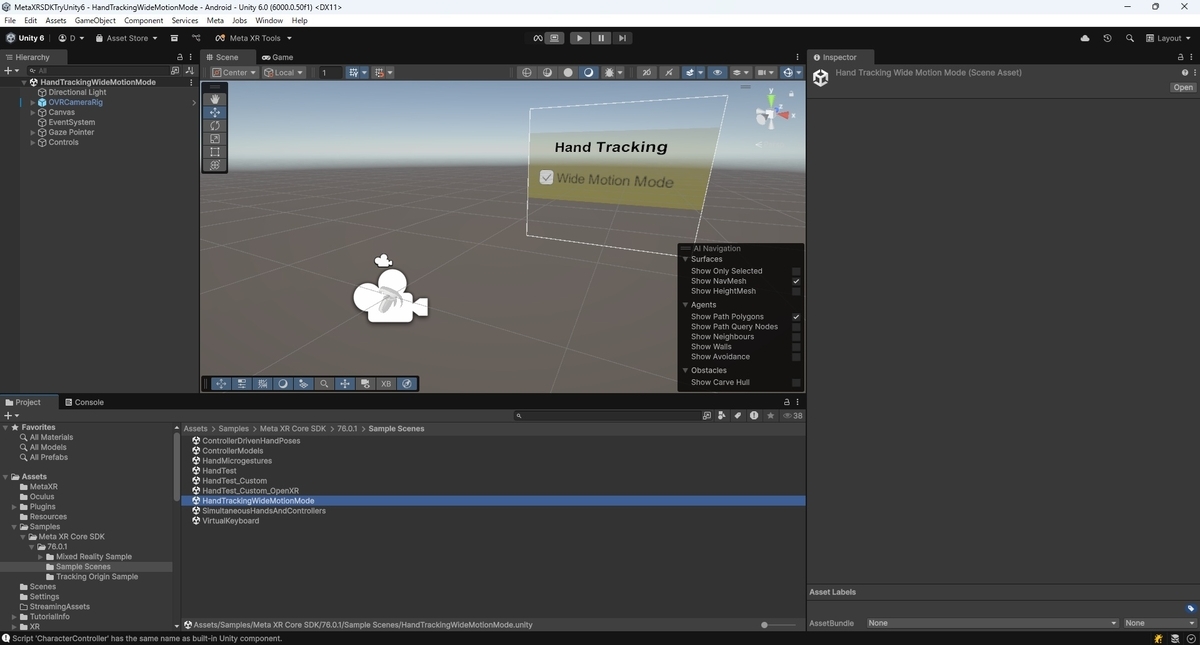

HandTrackingWideMotionMode

このサンプルはワイドモーションモードでハンドトラッキングを設定する方法を示しています。

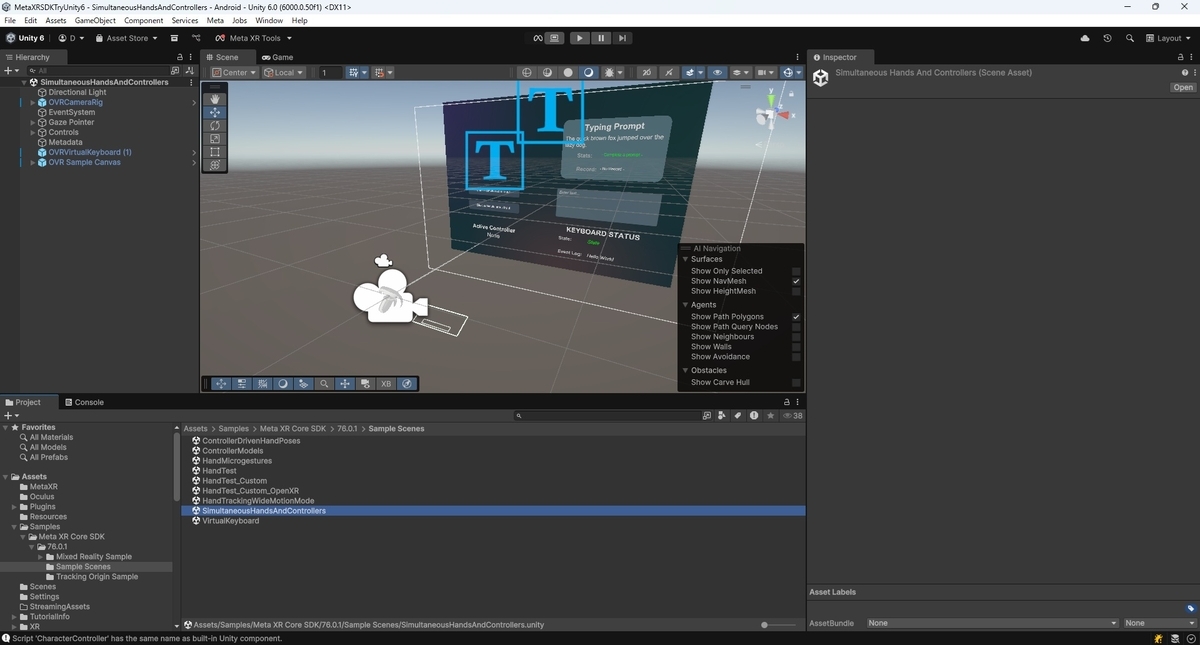

SimultaneousHandsAndControllers

このサンプルはコントローラーとハンドトラッキングの両方を単一のシーンで設定する方法を示しています。

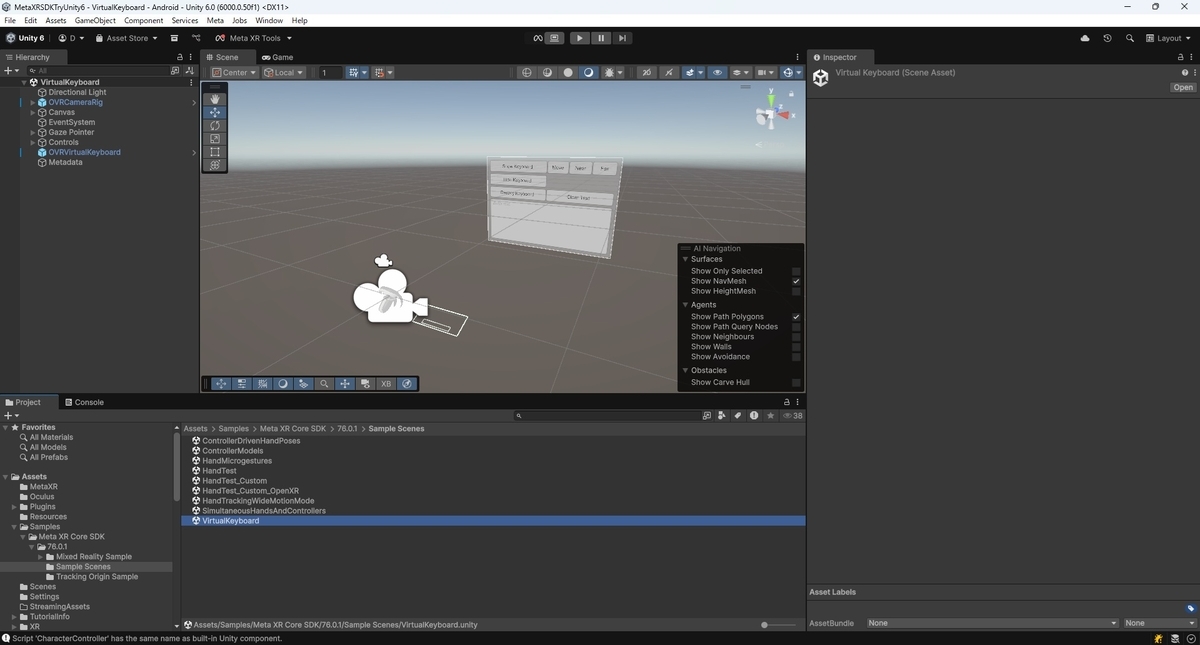

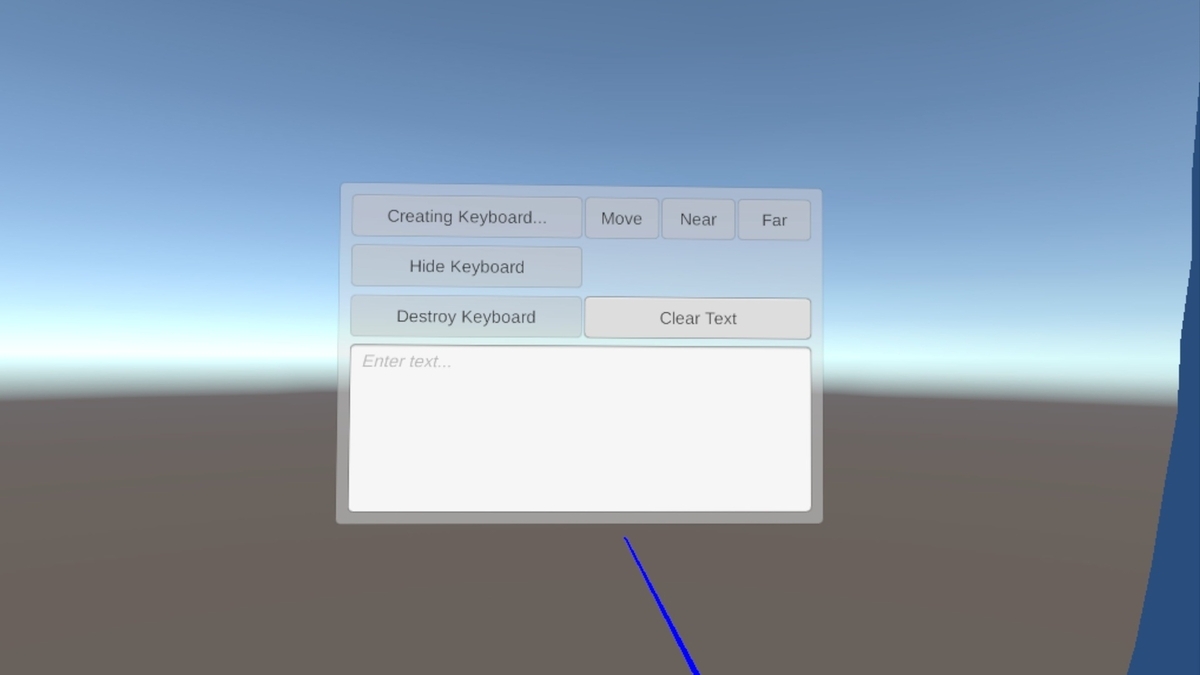

VirtualKeyboard

このサンプルはCore SDKでユーザーインプット用の仮想キーボードを実装する方法を示しています。

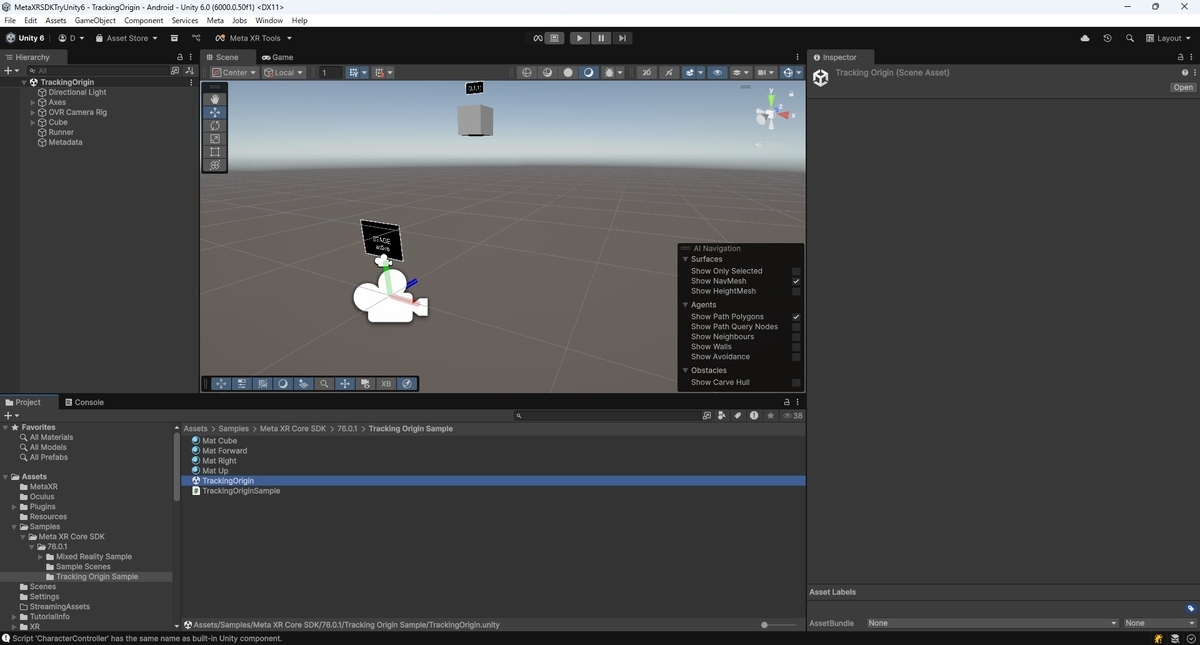

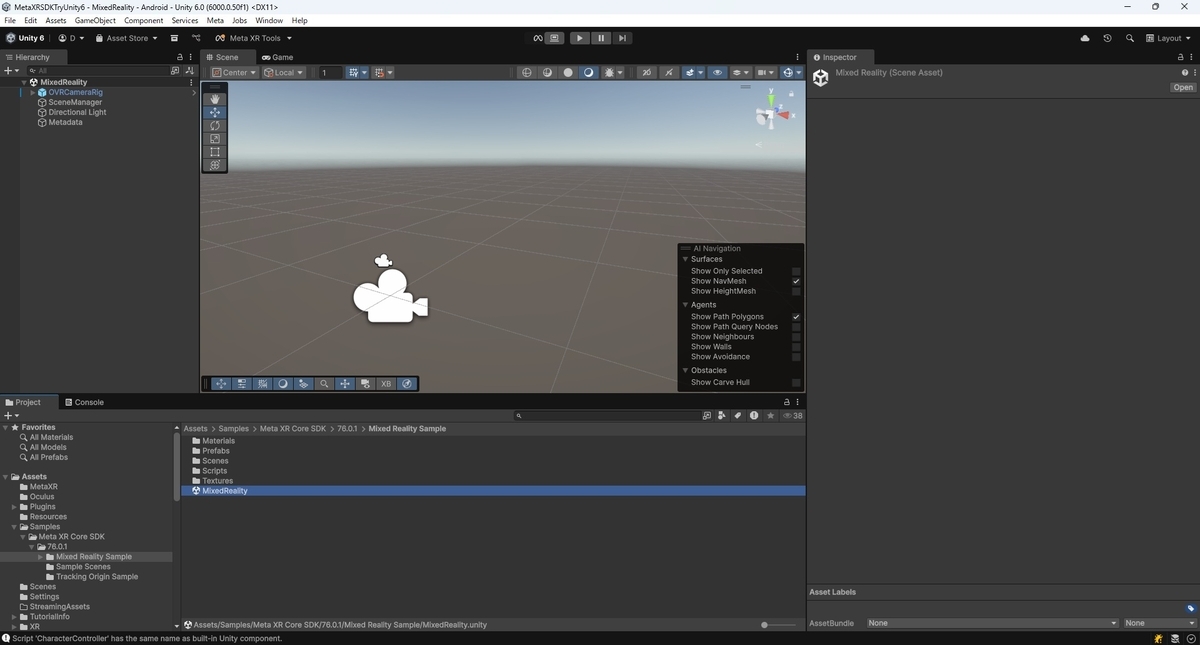

複合現実のサンプル(Mixed Reality Sample)

MixedReality

このサンプルではUnityシーンに複合現実の機能(シーン、パススルー、境界線など)を統合する方法について説明します。

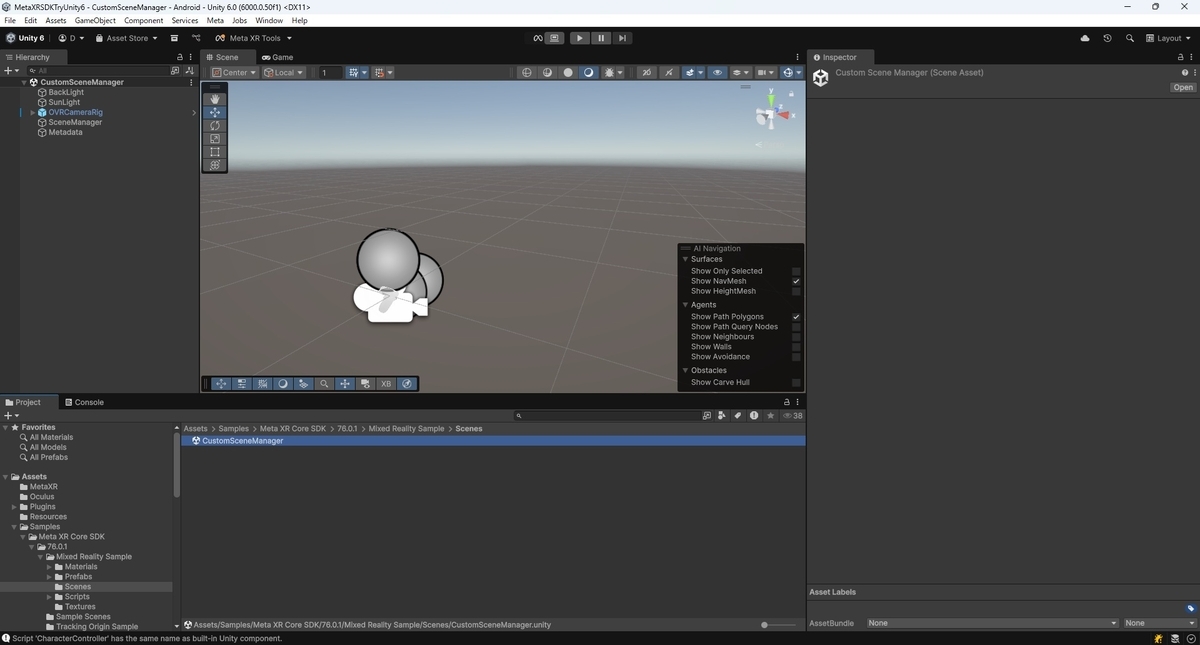

CustomSceneManager

このサンプルではOVRAnchor APIを使ってシーンデータに直接アクセスし、独自のシーンマネージャを作成する方法について説明します。